NumPy ファイルからのインポート

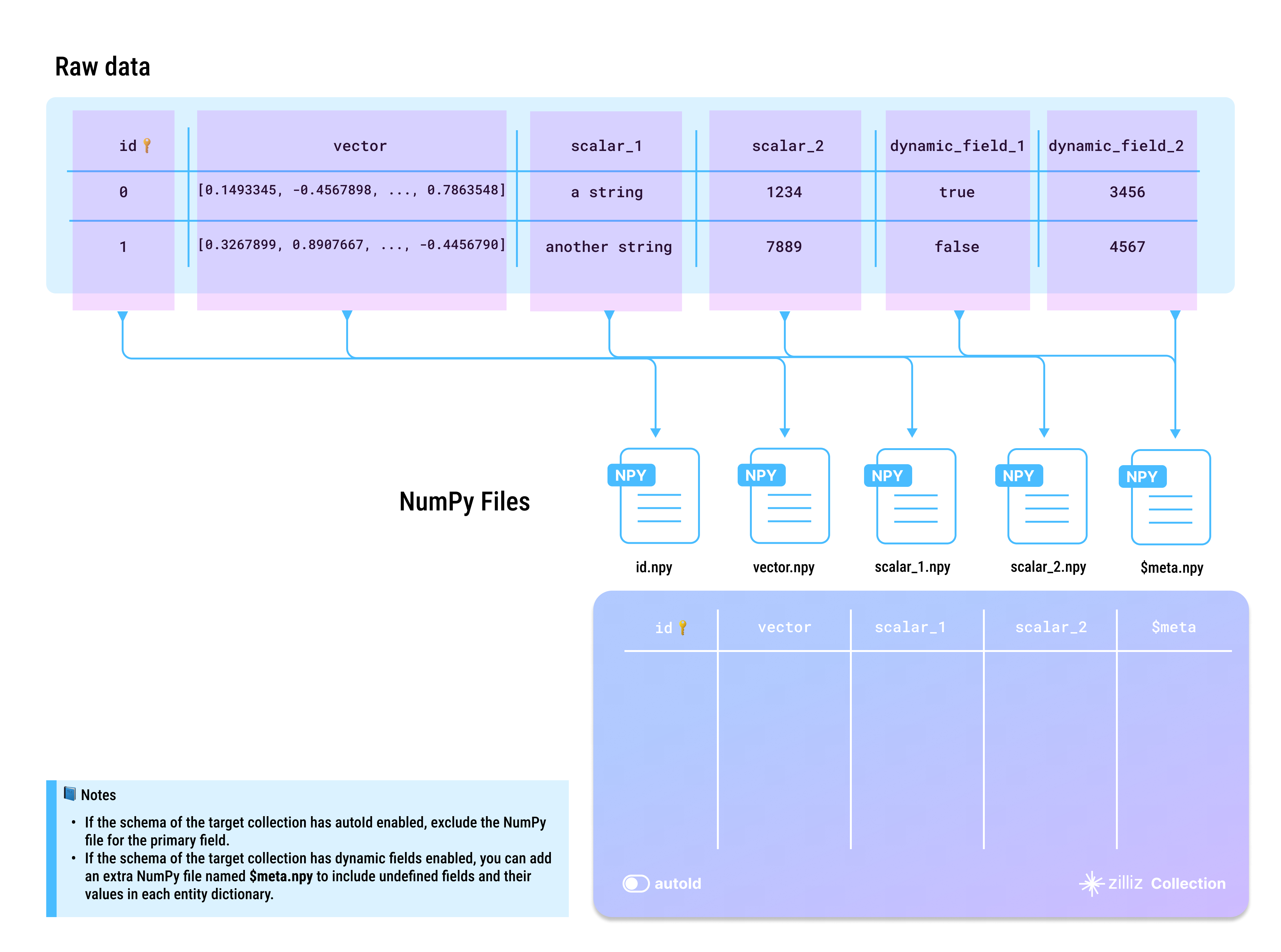

.npy 形式は、単一の配列を保存するための NumPy の標準バイナリ形式 であり、形状と dtype 情報を含むため、異なるマシン上で正しく再構築できることを保証します。生データを Parquet ファイルに準備するには、BulkWriter ツール の使用を推奨します。次の図は、生データを一連の .npy ファイルにどのようにマッピングできるかを示しています。

この機能は非推奨となりました。本番環境での使用は推奨されません。

- AutoID を有効にするかどうか

id フィールドはコレクションのプライマリフィールドとして機能します。プライマリフィールドを自動的にインクリメントするには、スキーマで AutoID を有効にできます。この場合、ソースデータの各行から id フィールドを除外する必要があります。

- 動的フィールドを有効にするかどうか

ターゲットコレクションで動的フィールドが有効になっている場合、事前定義されたスキーマに含まれていないフィールドを保存する必要がある場合、書き込み操作時に $meta カラムを指定し、対応するキーと値のデータを提供できます。

- 大文字と小文字の区別

辞書のキーとコレクションのフィールド名は大文字と小文字が区別されます。データ内の辞書キーがターゲットコレクションのフィールド名と完全に一致することを確認してください。ターゲットコレクションに id という名前のフィールドがある場合、各エンティティ辞書には id という名前のキーが必要です。ID や Id を使用するとエラーが発生します。

Directory structure

データを NumPy ファイルとして準備するには、同じサブセットのすべてのファイルをフォルダに配置し、これらのフォルダをソースフォルダ内にグループ化します。以下のツリー図に示すとおりです。

├── numpy-folders

│ ├── 1

│ │ ├── id.npy

│ │ ├── vector.npy

│ │ ├── scalar_1.npy

│ │ ├── scalar_2.npy

│ │ └── $meta.npy

│ └── 2

│ ├── id.npy

│ ├── vector.npy

│ ├── scalar_1.npy

│ ├── scalar_2.npy

│ └── $meta.npy

データのインポート

データの準備ができたら、以下のいずれかの方法を使用して、Zilliz Cloud コレクションにインポートできます。

ファイルが比較的小さい場合は、フォルダまたは複数パス方式を使用して一度にインポートすることを推奨します。このアプローチにより、インポートプロセス中に内部最適化が行われ、後のリソース消費を削減できます。

また、Milvus SDK を使用して Zilliz Cloud コンソール上でデータをインポートすることもできます。詳細については、データのインポート(コンソール) および データのインポート(SDK) を参照してください。

NumPy ファイルフォルダのリストからファイルをインポートする(推奨)

複数のパスからファイルをインポートする場合は、各 NumPy ファイルフォルダのパスを個別のリストに含め、すべてのリストをより上位レベルのリストにグループ化します。以下のコード例を参照してください。

curl --request POST \

--url "https://api.cloud.zilliz.com/v2/vectordb/jobs/import/create" \

--header "Authorization: Bearer ${TOKEN}" \

--header "Accept: application/json" \

--header "Content-Type: application/json" \

-d '{

"clusterId": "inxx-xxxxxxxxxxxxxxx",

"collectionName": "medium_articles",

"partitionName": "",

"objectUrls": [

["s3://bucket-name/numpy-folder-1/1/"],

["s3://bucket-name/numpy-folder-2/1/"],

["s3://bucket-name/numpy-folder-3/1/"]

],

"accessKey": "",

"secretKey": ""

}'

NumPyファイルフォルダからファイルをインポートする

ソースフォルダにインポートするNumPyファイルフォルダのみが含まれている場合、リクエストに次のようにしてソースフォルダをそのまま含めることができます:

curl --request POST \

--url "https://api.cloud.zilliz.com/v2/vectordb/jobs/import/create" \

--header "Authorization: Bearer ${TOKEN}" \

--header "Accept: application/json" \

--header "Content-Type: application/json" \

-d '{

"clusterId": "inxx-xxxxxxxxxxxxxxx",

"collectionName": "medium_articles",

"partitionName": "",

"objectUrls": [

["s3://bucket-name/numpy-folder/1/"]

],

"accessKey": "",

"secretKey": ""

}'

フォルダに複数の形式のファイルが含まれている場合、リクエストは失敗します。

ストレージパス

Zilliz Cloud はクラウドストレージからのデータインポートをサポートしています。以下の表に、データファイルの可能なストレージパスを示します。

Cloud | クイック例 |

|---|---|

AWS S3 | s3://bucket-name/numpy-folder/ |

Google Cloud Storage | gs://bucket-name/numpy-folder/ |

Azure Blob | https://myaccount.blob.core.windows.net/bucket-name/numpy-folder/ |

制限

クラウドストレージから NumPy ファイルをインポートする際に遵守する必要がある制限がいくつかあります。

有効な NumPy ファイルセットは、対象コレクションのスキーマ内のフィールド名に基づいて命名する必要があり、ファイル内のデータは対応するフィールド定義と一致している必要があります。

インポート 方法 | インポートあたりの最大サブディレクトリ数 | サブディレクトリあたりの最大サイズ | インポート合計の最大サイズ |

|---|---|---|---|

ローカルファイルから | サポートされていません | ||

オブジェクトストレージから | 1,000 サブディレクトリ | 10 GB | 1 TB |

データファイルの準備 を参照して独自にデータを再構築するか、BulkWriter ツール を使用してソースデータファイルを生成することができます。上記の図のスキーマに基づいて準備されたサンプルデータはこちらからダウンロードできます。